DeepSeek 模型接入指南

内部资料,请扫码登录

pigcloud

# DeepSeek 模型接入指南

本文将指导您如何在 PIG AI 平台中接入和使用 DeepSeek 深度推理模型。DeepSeek 是一个强大的 AI 模型,可以帮助您完成各种复杂的推理任务。

# 什么是 DeepSeek?

DeepSeek 是一个先进的人工智能模型,专门设计用于处理复杂的推理任务。它可以:

- 理解和分析复杂问题

- 提供详细的解答和推理过程

- 支持多种语言的交互

# 使用方式

您可以通过以下两种方式使用 DeepSeek 模型:

# 1. 在线模型(推荐新手使用)

这种方式最简单,适合所有用户,无需部署,直接使用官方API即可。

设置步骤:

- 登录 PIG AI 平台

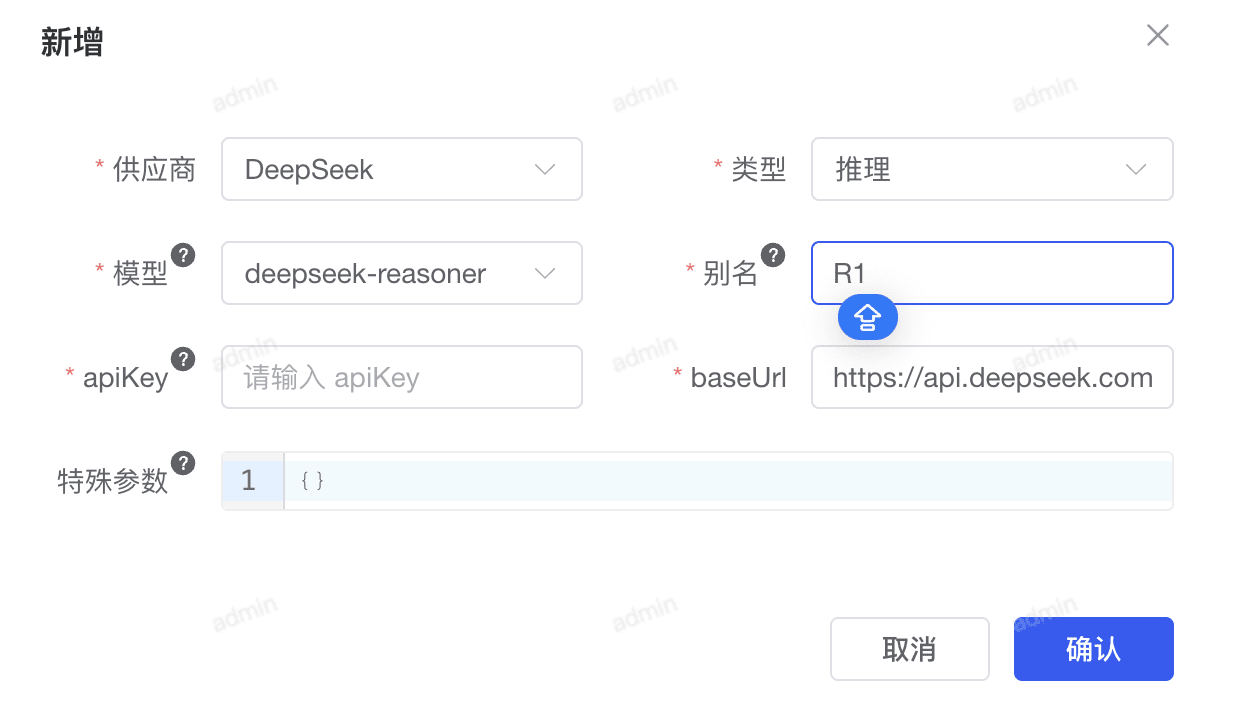

- 进入"模型配置"页面,点击"新增模型"

- 按以下信息填写:

- 供应商:选择

DeepSeek - 类型:选择

推理模型 - 模型名称:DeepSeek Reasoner

- 供应商:选择

# 获取 API KEY

- 访问 DeepSeek 官方平台 (opens new window):

- 注册并登录账号

- 在平台中创建您的 API KEY

配置示例:

# 2. 私有模型部署(适合进阶用户)

如果您需要更好的性能和数据隐私保护,可以选择部署私有模型。

部署前提条件

- 需要有 Linux 或类 Unix 系统环境

- 显卡显存需求:至少 16GB 可用显存(针对14B模型)

- 建议有基本的命令行操作经验

具体步骤:

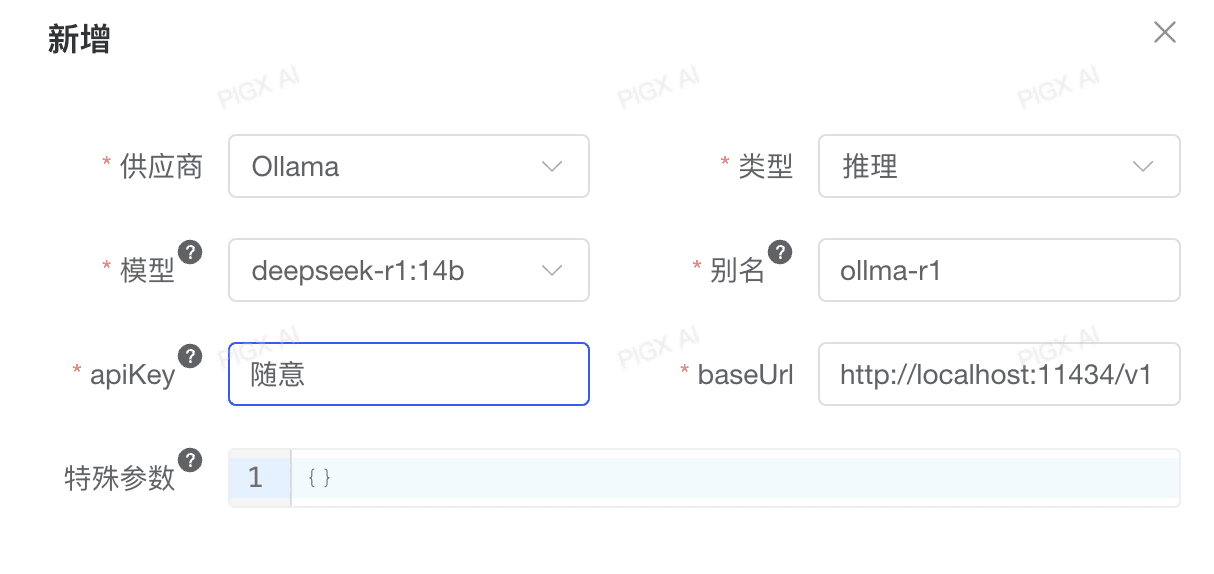

- 首先按照【私有模型】章节的说明部署 ollama (opens new window)

- 运行以下命令部署模型:

ollama run deepseek-r1:14b

配置示例:

注意事项

- 确保配置的模型名称与 ollama 运行时的模型名称完全一致

- 部署14B模型需要至少16GB显存,请确保您的硬件满足要求

# 开始使用

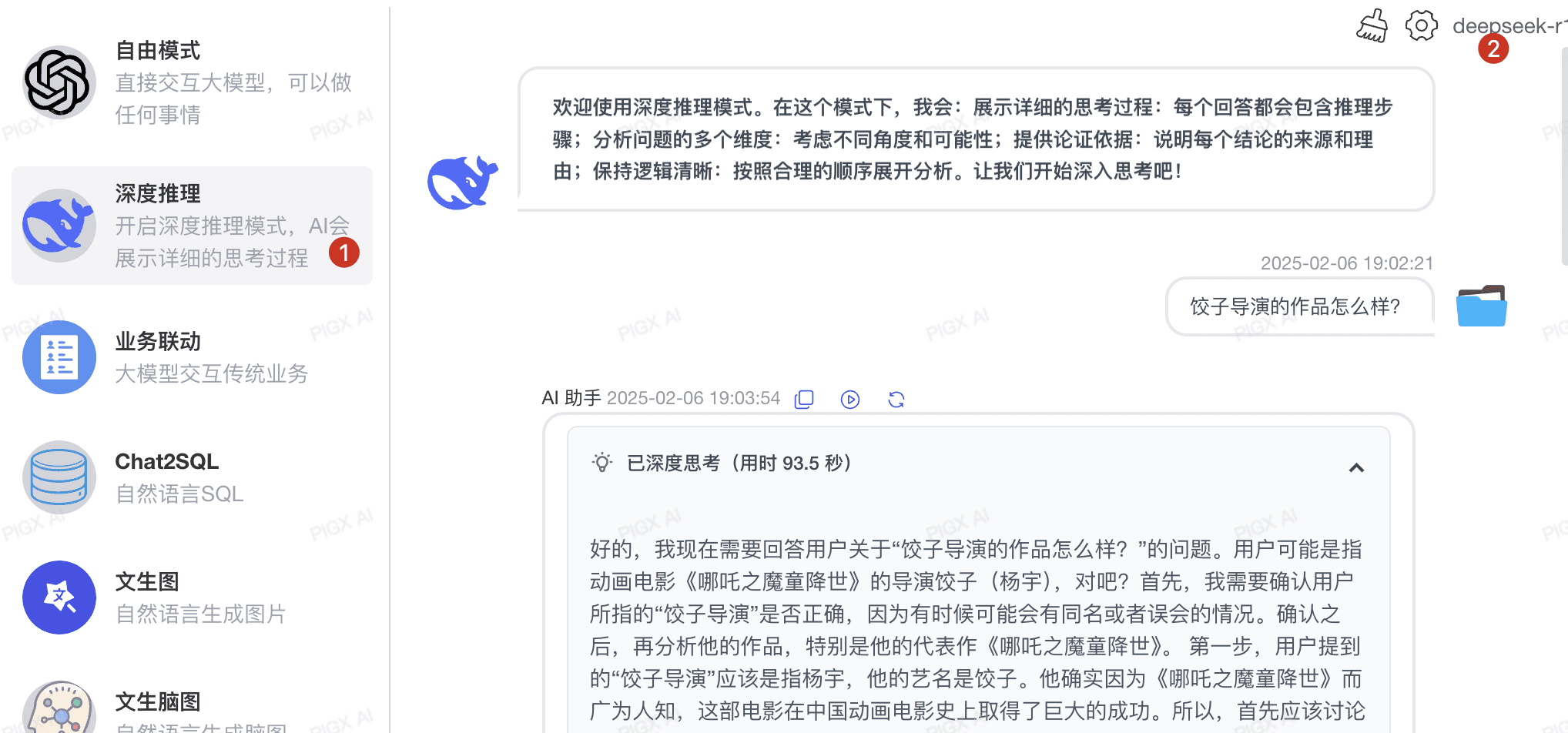

完成配置后,您可以在"AI 助手 > 深度推理"中开始使用 DeepSeek 模型:

# 常见问题

模型无法正常调用?

- 检查 API KEY 是否正确配置

- 确认模型名称是否与配置匹配

- 检查网络连接是否正常

私有部署时显存不足?

- 可以尝试使用较小的模型版本

- 清理其他占用显存的程序

- 升级硬件配置